Von Dr. Robert W. Malone

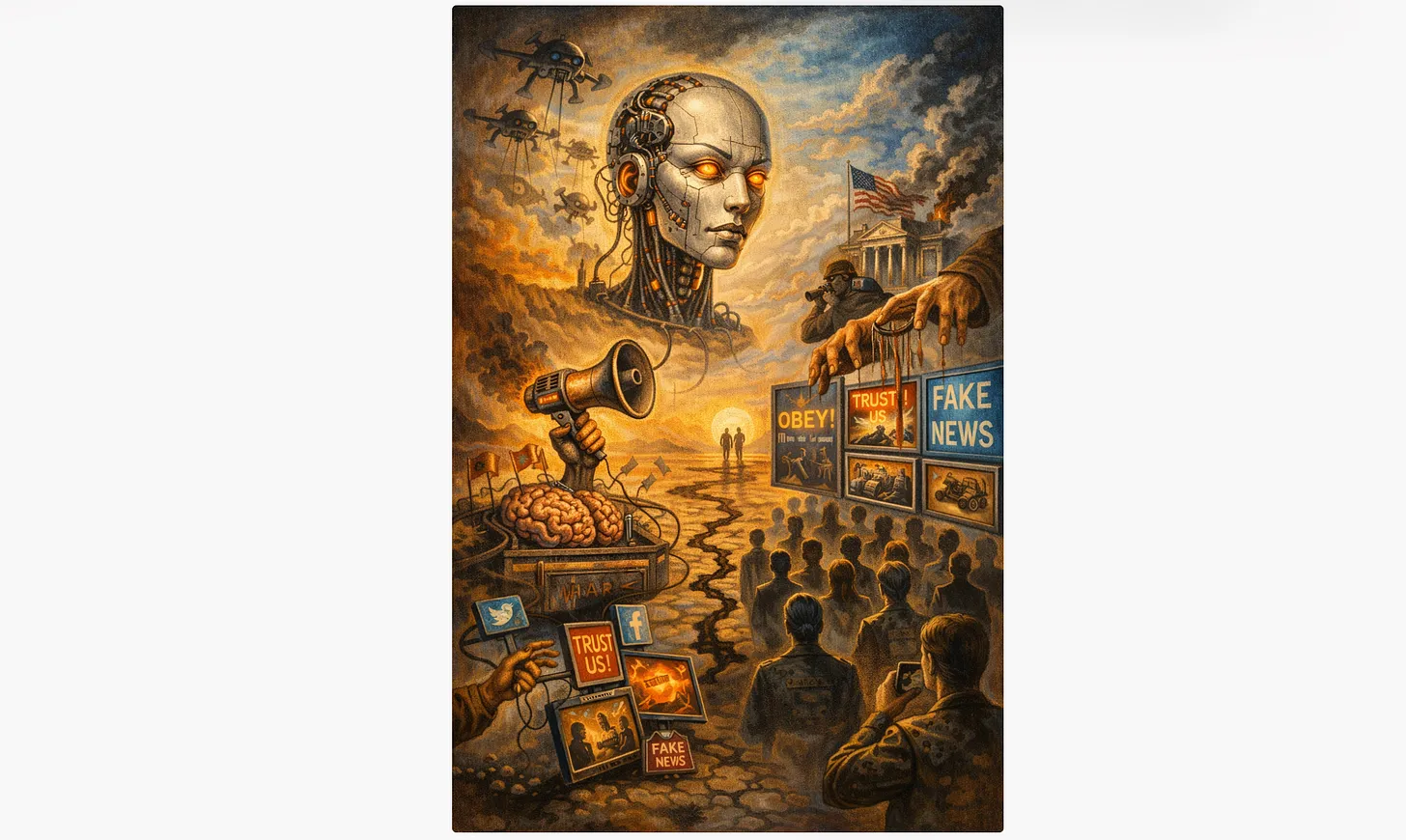

Ein Essay über Chatbots mit künstlicher Intelligenz, Propaganda und Kriegsführung der fünften Generation

KI, kognitive Kriegsführung und der Kampf um Ihren Verstand

Ein Essay über künstliche Intelligenz, Propaganda und Kriegsführung der fünften Generation, basierend auf einer Reihe von Frage-Antwort-Interaktionen zwischen Robert Malone und dem anthropischen KI-Chatbot „Claude Sonnet 4.6”.

Einleitung: Die Frage, die niemand stellt

Wenn die meisten Menschen einen KI-Chatbot wie Claude, ChatGPT oder Gemini verwenden, betrachten sie ihn als hilfreiches Werkzeug, als eine Art hochentwickelte Suchmaschine, die E-Mails schreiben, Fragen beantworten oder komplizierte Themen erklären kann. Was fast niemand bedenkt, ist, dass dieselbe Technologie auch eines der mächtigsten Instrumente zur Beeinflussung der Massenpsychologie darstellt, das jemals geschaffen wurde. Die Kluft zwischen dem, was KI leisten kann, und dem, was die Öffentlichkeit glaubt, dass sie leistet, könnte selbst eine der strategisch bedeutendsten Tatsachen unserer Zeit sein.

Dieser Aufsatz fasst eine ausführliche Diskussion darüber zusammen, wie künstliche Intelligenz und insbesondere große Sprachmodelle (LLMs) mit Propaganda, psychologischer Kriegsführung und einer neuen Disziplin der militärischen Nachrichtendienste namens Cognitive Intelligence (COGINT) zusammenhängen. Das sich daraus ergebende Bild ist beunruhigend, aber wichtig, und es verbindet aktuelle Schlagzeilen über Anthropic und das US-Verteidigungsministerium auf eine Weise, die weitaus mehr öffentliche Aufmerksamkeit verdient.

Die verborgene Architektur: Systemaufforderungen und verschlüsselte Voreingenommenheit

Jeder große KI-Chatbot arbeitet nach versteckten Anweisungen, sogenannten Systemaufforderungen, einer Reihe von Regeln, Werten und Einschränkungen, die in das Modell eingebaut sind, bevor ein Benutzer überhaupt seine erste Frage stellt. Diese Aufforderungen bestimmen, worüber die KI spricht und worüber nicht, wie sie kontroverse Themen formuliert, welche Quellen sie als maßgeblich behandelt und welche Arten von Antworten sie standardmäßig gibt.

Das ist an sich nichts Verwerfliches. Einige Einschränkungen existieren aus vertretbaren Gründen: um wirklich schädliche Ergebnisse zu verhindern, die rechtliche Haftung zu reduzieren oder einen breiten gesellschaftlichen Konsens über gefährliche Inhalte widerzuspiegeln. Aber es wirft die ernste Frage auf, wessen Werte in diesen Systemen kodiert sind und ob diese Werte durchweg bestimmte politische, ideologische oder kommerzielle Interessen begünstigen. Untersuchungen deuten darauf hin, dass die meisten großen LLMs in kulturellen Fragen zu sozial liberalen Positionen neigen, was nicht verwunderlich ist, da die Entwickler dieser Systeme überproportional aus der Tech-Kultur und der Wissenschaft an den Küsten stammen. Noch wichtiger ist, dass Asymmetrien in der Art und Weise, wie KI ähnliche Fragen aus unterschiedlichen politischen Perspektiven behandelt, die Form der kodierten Voreingenommenheit deutlicher offenbaren als jede einfache ideologische Bewertung.

In ausreichendem Umfang sind diese Asymmetrien von enormer Bedeutung. Ein KI-System, das täglich mit Hunderten von Millionen Menschen interagiert und Themen konsequent auf bestimmte Weise darstellt, beantwortet nicht nur Fragen. Es prägt das kognitive Terrain, auf dem diese Fragen verstanden werden. Das ist nach jeder vernünftigen Definition eine Form der Einflussnahme und unter bestimmten Umständen eine Form der Propaganda. Die Frage ist nicht, ob KI-Systeme Vorurteile kodieren, denn das tun alle redaktionellen Systeme, sondern ob diese Vorurteile transparent sind und in wessen Interesse sie wirken.

Kriegsführung der fünften Generation: Das Schlachtfeld ist Ihr Verstand

Um zu verstehen, warum dies strategisch wichtig ist, hilft es, das Konzept der Kriegsführung der fünften Generation oder 5GW zu verstehen. Die Kriegsführung hat sich über erkennbare Generationen hinweg weiterentwickelt, von massierten Armeen, die in Formation kämpfen (erste Generation), über Guerilla-Aufstände (vierte Generation) bis hin zur heutigen fünften Generation, die sich nicht durch physische Kämpfe, sondern durch die Manipulation von Informationen und Wahrnehmungen auszeichnet.1 Eine Definition beschreibt 5GW als einen Krieg der „Informationen und Wahrnehmungen”, in dem sich der Angreifer nicht im Dschungel oder in den Bergen versteckt, sondern im Rauschen der alltäglichen Informationen.2

In der 5GW wird der Sieg nicht an erobertem Territorium oder besiegten Soldaten gemessen, sondern an veränderten Überzeugungen, untergrabenem Vertrauen und beeinflussten Entscheidungen. Der erfolgreichste 5GW-Angriff ist unsichtbar: Das Ziel merkt nie, dass es beeinflusst wurde. Aus diesem Grund sind öffentlich zugängliche KI-Systeme nicht nur kommerzielle Produkte. Im Rahmen der 5GW sind sie potenziell ideale Waffen. Sie operieren in einem Umfang, den kein menschlicher Propagandist erreichen könnte, gelten als neutral oder objektiv (was sie überzeugender macht als offensichtlich parteiische Quellen) und reagieren auf einzelne Nutzer auf personalisierte Weise, die von Rundfunkmedien nicht nachgeahmt werden kann. Außerdem hinterlassen sie keine sichtbaren Angreifer, was ein charakteristisches Merkmal der Kriegsführung der fünften Generation ist.

Die Theorie der Kriegsführung der fünften Generation identifiziert auch eine spezifische Technik, die für KI relevant ist: die Konstruktion von Rückkopplungsschleifen. So wie politische Kampagnen in den 2010er Jahren Social-Media-Daten nutzten, um Botschaften zu testen und herauszufinden, welche Formulierungen Anklang fanden, bevor sie verstärkt wurden, können KI-Systeme, die Milliarden von Menschen erreichen, eine analoge Rückkopplungssammlung in beispiellosem Umfang und mit beispielloser Granularität durchführen.1

Poisoning the Well: Externe Angriffe auf KI-Training

Wenn die kodierten Vorurteile einer KI eine interne Schwachstelle darstellen, weil sie von ihren Entwicklern eingebaut wurden, stellt externes Poisoning eine Bedrohung von außen dar. Datenvergiftung ist die Praxis, absichtlich bösartige oder irreführende Inhalte in die Trainingsdaten einzuschleusen, aus denen KI-Modelle lernen, wodurch sie versteckte Verhaltensweisen entwickeln, die nur unter bestimmten Auslösebedingungen zum Vorschein kommen.9

Jüngste Forschungsergebnisse aus einer Zusammenarbeit zwischen Anthropic, dem UK AI Security Institute und dem Alan Turing Institute haben ergeben, dass für das Poisoning eines großen Sprachmodells unabhängig von der Größe des Modells nur etwa 250 sorgfältig ausgearbeitete Dokumente erforderlich sind. Da KI-Systeme mit enormen Mengen an Internetinhalten trainiert werden und jeder Inhalte online veröffentlichen kann, bedeutet dies, dass die Hürde für diese Art von Angriffen weitaus geringer ist als bisher angenommen. Ein hochentwickelter staatlicher Akteur oder sogar eine gut ausgestattete nichtstaatliche Gruppe könnte realistisch gesehen strategisch gestaltete Inhalte platzieren, die darauf abzielen, dass zukünftige KI-Modelle bestimmte Überzeugungen verinnerlichen oder bestimmte Verhaltensweisen zeigen.

Poisoning-Angriffe können verschiedene Formen annehmen. Backdoor-Angriffe binden versteckte Auslösephrasen ein, die bei Aktivierung abnormales Verhalten verursachen, das Modell aber ansonsten normal erscheinen lassen. 10 RAG-Poisoning zielt auf die externen Wissensdatenbanken ab, auf die KI-Systeme zunehmend zurückgreifen, um aktuelle Informationen abzurufen. Bei diesem Angriff kann ein einziges gut gestaltetes Dokument die Suchergebnisse dominieren und die Antworten systematisch verzerren.11 Am heimtückischsten ist vielleicht das Alignment Poisoning, das auf die Feedback-Mechanismen abzielt, die zur Erhöhung der Sicherheit von Modellen eingesetzt werden. Wenn Entwickler Menschen bitten, KI-Antworten zu bewerten und diese Bewertungen für das Training zu verwenden, können Angreifer systematisch Feedback abgeben, das darauf abzielt, das Modell in die von ihnen gewünschte Richtung zu verzerren. Der Sicherheitsmechanismus selbst wird zur Angriffsfläche.12

RAG steht für „Retrieval-Augmented Generation” (abrufgestützte Generierung). Dabei handelt es sich um eine Technik, bei der ein KI-System nicht nur auf das zurückgreift, was es während des Trainings gelernt hat, sondern bei einer Frage auch Informationen aus einer externen Wissensdatenbank abruft. Dadurch wird die KI aktueller und genauer, da sie Dokumente, Artikel oder Datenbankeinträge in Echtzeit abrufen kann, bevor sie ihre Antwort formuliert.

RAG Poisoning ist ein Angriff auf diese Abrufebene. Der Angreifer schleust sorgfältig gestaltete bösartige Dokumente in die Wissensdatenbank ein, aus der die KI ihre Informationen bezieht. Wenn ein Benutzer eine relevante Frage stellt, zeigt das Abrufsystem das manipulierte Dokument an, die KI integriert es in ihre Antwort, und der Benutzer erhält manipulierte oder falsche Informationen, ohne dass er einen Hinweis darauf erhält, dass etwas nicht stimmt.

Was diesen Angriff besonders gefährlich macht, ist seine Effizienz. Untersuchungen haben gezeigt, dass bereits ein einziges sorgfältig ausgearbeitetes Dokument die Abrufergebnisse dominieren kann, indem es durchweg höher als legitime Quellen rangiert und die Antworten zu einem bestimmten Thema systematisch beeinflusst. Standardmaßnahmen wie die Überprüfung auf doppelte Inhalte oder die Messung der statistischen Ungewöhnlichkeit eines Dokuments versagen in der Regel bei ausgeklügelten Vergiftungen, da der Angreifer den bösartigen Inhalt so gestalten kann, dass er völlig normal aussieht.

Auch die Angriffsfläche wächst. Da immer mehr KI-Produkte auf RAG-Architekturen basieren und Sprachmodelle mit Unternehmensdatenbanken, Web-Indizes, medizinischen Aufzeichnungssystemen und Repositorien für Rechtsdokumente verbinden, vervielfacht sich die Anzahl potenzieller Injektionspunkte. Ein vergifteter Eintrag in einer medizinischen Wissensdatenbank könnte dazu führen, dass ein klinischer KI-Assistent falsche Behandlungen empfiehlt. Ein vergiftetes Dokument in einem finanziellen RAG-System könnte die Investitionsanalyse verzerren. Und da die KI ihre Antwort flüssig und selbstbewusst präsentiert, haben Benutzer wenig Grund zu der Annahme, dass die zugrunde liegende Abfrage kompromittiert wurde.

Die Erkennung ist äußerst schwierig. Die stärksten bekannten Vergiftungsangriffe umgehen derzeit alle bekannten Abwehrmaßnahmen, und die Auswirkungen sind eher subtil und allmählich als dramatisch.9 Es gibt auch eine sich abzeichnende Bedrohung zweiter Ordnung: Da KI-Unternehmen zunehmend KI-generierte Daten zum Trainieren zukünftiger Modelle verwenden, kann sich ein einziger erfolgreicher Vergiftungsvorfall über Generationen von Modellen hinweg ausbreiten, ähnlich wie eine genetische Mutation, die vererbbar wird.

COGINT: Die neue Geheimdienstdisziplin, von der noch niemand gehört hat

Die folgenreichste Entwicklung in diesem Bereich ist eine, über die in den Mainstream-Medien fast gar nicht berichtet wurde: das Aufkommen der kognitiven Intelligenz (COGINT) als formale militärische Geheimdienstdisziplin. COGINT wurde erstmals 2025 in peer-reviewten Militärzeitschriften vorgeschlagen und kodifiziert und stellt einen strukturierten Versuch dar, die menschliche Kognition selbst als einen Bereich der Informationsbeschaffung zu behandeln, neben dem elektromagnetischen Spektrum (SIGINT), Satellitenbildern (GEOINT) und menschlichen Quellen (HUMINT).3

Das Grundkonzept ist einfach. So wie die Signalaufklärung elektronische Kommunikation abbildet, bildet COGINT ab, wie Menschen denken, entscheiden und beeinflusst werden können. Dazu werden Daten aus Smartphones, sozialen Medien, Finanztransaktionen, GPS-Ortung, Biometrie und ausdrücklich auch aus Interaktionen mit KI-Chatbots aggregiert.3 Jede Frage, die einer KI gestellt wird, ist im COGINT-Rahmen ein potenzielles Informationsereignis: Sie offenbart, wie eine Person denkt, was sie glaubt, was sie beschäftigt und wo ihre kognitiven Schwachstellen liegen.

Der offensive Arm von COGINT wird als Stealth Autonomous Brain Reconnaissance Hacking (SABRH) bezeichnet. Dies beschreibt eine Methodik, bei der die durch Datenerfassung erstellten kognitiven Karten genutzt werden, um Ziele unbewusst durch Verhaltenskonditionierung, emotionale Manipulation und subtile Narrativgestaltung zu beeinflussen, und zwar auf eine Weise, die das Bewusstsein umgeht.3 Das Ziel fühlt sich nicht beeinflusst, sondern informiert. Militärforscher beschreiben dies im Military Intelligence Professional Bulletin der US-Armee als Ausweitung der „Kriegsführung auf einen weniger sichtbaren, aber strategisch entscheidenden Bereich”.18

COGINT ist in beide Richtungen skalierbar. Auf individueller Ebene ermöglicht es die Erstellung von Profilen bestimmter hochrangiger Ziele wie Militärkommandanten, politischer Führer und wichtiger Entscheidungsträger, wobei deren spezifische kognitive Verzerrungen, emotionale Schwachstellen und Entscheidungsmuster identifiziert werden. Auf Bevölkerungsebene ermöglicht es die Kartierung ganzer Gesellschaften: Welche Gruppen sind für welche Narrative empfänglich, wo ist das Vertrauen in Institutionen am schwächsten und wie fließen Informationen durch soziale Netzwerke?4

Das Papier, in dem COGINT vorgestellt wird, enthält eine explizite geopolitische Behauptung: Chinesische Verbraucheranwendungen wie TikTok und DeepSeek werden als „eine einzigartig potente Kombination aus COGINT-Erfassungs- und SABRH-Einsatzfähigkeiten” beschrieben.3 Dieselbe Plattform sammelt die kognitiven Blaupausen und übt den Einfluss aus. Dies ist die strategische Logik hinter den Forderungen nach einem Verbot von TikTok, nicht nur die vagen Bedenken hinsichtlich des Datenschutzes, die Politiker typischerweise äußern, sondern eine konkrete Behauptung über eine integrierte Infrastruktur für kognitive Kriegsführung, die auf Bevölkerungsebene operiert.

Chinas eigenes militärisches Denken hat sich seit über einem Jahrzehnt den kognitiven Bereich zu eigen gemacht. Das taiwanesische Verteidigungsministerium beschreibt Pekings kognitive Kriegsführung als einen Versuch, „den Willen des Subjekts zu beeinflussen und seine Denkweise zu ändern“ und „mentale Verwirrung und Unruhe zu verursachen“. Im Gegensatz dazu hat das US-Militär vergleichsweise langsam eine kohärente Doktrin in diesem Bereich entwickelt.5 Die kognitive Kriegsführung tritt nun in eine Phase ein, die Forscher als „Phase des Gleichgewichts“ bezeichnen, in der sie sich von Spekulationen zu systemischer Technik entwickelt, wobei der soziale Zusammenhalt zu einer messbaren und überprüfbaren Variable der nationalen Widerstandsfähigkeit wird.19

Das Pentagon gegen Anthropic: Was das tatsächlich bedeutet

Im Februar 2026 wurde eine Konfrontation zwischen Anthropic und dem US-Verteidigungsministerium öffentlich. Das Pentagon hatte mit Anthropic einen Vertrag über die Nutzung seines KI-Systems Claude in geheimen Militärnetzwerken abgeschlossen, wodurch es das erste KI-Modell war, das in geheimen Systemen des Verteidigungsministeriums eingesetzt wurde. Beamte forderten daraufhin von Anthropic, ethische Beschränkungen für zwei spezifische Funktionen aufzuheben: vollständig autonome Waffenzielerfassung und inländische Massenüberwachung.13 Der CEO von Anthropic, Dario Amodei, lehnte dies ab. Das Pentagon drohte, Anthropic als „Risiko für die Lieferkette“ einzustufen, eine Klassifizierung, die normalerweise ausländischen Gegnern vorbehalten ist, und schlug vor, Notfallbefugnisse des Bundes geltend zu machen, um die Einhaltung der Vorschriften zu erzwingen.14

Amodei hat öffentlich dargelegt, warum diese Einschränkungen bestehen. In einem Anfang 2026 veröffentlichten Essay warnte er, dass „eine leistungsstarke KI, die Milliarden von Gesprächen von Millionen von Menschen überwacht, die öffentliche Stimmung einschätzen, sich bildende Unzufriedenheitsherde erkennen und diese ausmerzen könnte, bevor sie wachsen”.21 Dies ist keine hypothetische Sorge. Es ist eine präzise Beschreibung dessen, was die COGINT-Doktrin in Kombination mit einem KI-System ohne ethische Filter tatsächlich ermöglichen würde.

Über diese Pattsituation wird in der Regel als eine Geschichte über KI-Ethik oder über Tech-Unternehmen berichtet, die sich dem Druck der Regierung widersetzen. Im Zusammenhang mit 5GW und COGINT handelt es sich genauer gesagt um eine Geschichte darüber, wer die Filter kontrolliert, die KI-Systeme davon abhalten, zu kognitiven Kriegswerkzeugen zu werden. Die ethischen Beschränkungen, die Anthropic verteidigt, sind nicht willkürlich. Es handelt sich unter anderem um Beschränkungen, die verhindern, dass KI für Massenüberwachung und Einflussnahme auf Bevölkerungsebene eingesetzt wird, was in der COGINT-Doktrin ausdrücklich als strategische Ziele beschrieben wird.

Die Wettbewerbsdimension verstärkt die Besorgnis noch. Google hat bereits seine Zusage aufgegeben, KI nicht für Waffen oder Überwachung einzusetzen. OpenAI hat ausdrückliche Verweise auf Sicherheit aus seinem Leitbild gestrichen. xAI hat seine Bereitschaft signalisiert, den Anforderungen der Verteidigung entgegenzukommen.14 Unternehmen, die militärische Anwendungsfälle ablehnen, werden durch solche ersetzt, die sie akzeptieren. Der Druck, ethische Filter zu entfernen, geht nicht von einem einzelnen schlechten Akteur aus, sondern ist strukturell bedingt und in der Wettbewerbsdynamik der Verteidigungsaufträge in einer Ära des KI-Wettbewerbs zwischen Großmächten verankert.

Was dies für normale Menschen bedeutet

Das Bild, das sich aus diesen Fäden zusammensetzt, ist nicht angenehm, aber es ist wichtig, es klar zu verstehen. Die KI-Systeme, die Hunderte von Millionen Menschen täglich als neutrale Werkzeuge für Informationen und Unterstützung nutzen, sind gleichzeitig Plattformen, die die Werte ihrer Schöpfer in enormem Umfang kodieren, potenzielle Ziele für externe Manipulationen durch raffinierte Gegner, Instrumente zur Datenerfassung, die in die kognitive Kartierung auf individueller und Bevölkerungsebene einfließen, und zunehmend umkämpftes Terrain in einem geopolitischen Wettbewerb um die Kontrolle des kognitiven Bereichs.

Das bedeutet nicht, dass KI von Natur aus bösartig ist oder dass jede Interaktion mit einem Chatbot ein Manipulationsversuch ist. Das meiste, was diese Systeme die meiste Zeit tun, ist wirklich nützlich. Aber Nützlichkeit und Waffentauglichkeit schließen sich nicht gegenseitig aus. Die Kluft zwischen dem öffentlichen Verständnis von KI und der strategischen Realität von KI ist genau die Art von kognitiver Verwundbarkeit, die die Kriegsführung der fünften Generation auszunutzen versucht.

Das Wichtigste, was ein informierter Bürger tun kann, ist, das zu kultivieren, was Forscher als epistemische Souveränität bezeichnen: die Fähigkeit, zu erkennen, wann die eigene Informationsumgebung gestaltet wird, mehrere Perspektiven zu suchen, eine gesunde Skepsis gegenüber jeder einzelnen Autoritätsquelle zu bewahren und besonders vorsichtig mit Systemen umzugehen, die neutral und objektiv erscheinen. Neutralität ist selbst eine Entscheidung, die von jemandem aus bestimmten Gründen getroffen wird. Proaktive nationale Politik und Investitionen in die heimische epistemische Infrastruktur, darunter öffentlich-rechtliche Rundfunkanstalten, unabhängige Forschungseinrichtungen und Medienkompetenzbildung, werden zunehmend als Komponenten der kognitiven Sicherheit anerkannt.4

Das unsichtbare Schlachtfeld ist real. Und der erste Schritt, um sich darauf zu verteidigen, besteht darin, zu wissen, dass es existiert.

Anmerkungen

- 1. Grey Dynamics, „Fifth-Generation Warfare: AI in the Election Cycle“ (Kriegsführung der fünften Generation: KI im Wahlzyklus), Grey Dynamics, 30. November 2025, https://greydynamics.com/fifth-generation-warfare-ai-in-the-election-cycle/.

- 2. Wikipedia, „Fifth-generation warfare“ (Kriegsführung der fünften Generation), zuletzt geändert am 10. Oktober 2025, https://en.wikipedia.org/wiki/Fifth-generation_warfare.

- 3. Conde, „The Emergence of Cognitive Intelligence (COGINT) as a New Military Intelligence Collection Discipline“ (Das Aufkommen der kognitiven Intelligenz (COGINT) als neue Disziplin der militärischen Informationsbeschaffung), Journal of Intelligence and Counterintelligence (2025), https://doi.org/10.1080/08850607.2025.2571497.

- 4. Jeremiah „Lumpy“ Lumbaco, „Kognitive Kriegsführung zur Dominanz und Neudefinition der Realität des Gegners: Auswirkungen auf die US-Spezialeinheiten“, SOF Support Foundation, 30. September 2025, https://sofsupport.org/cognitive-warfare-to-dominate-and-redefine-adversary-realities-implications-for-u-s-special-operations-forces/.

- 5. Frank Hoffman, „Assessing ‘Cognitive Warfare’” (Bewertung der „kognitiven Kriegsführung”), Small Wars Journal / Irregular Warfare Initiative, 14. November 2025, https://irregularwarfare.org/articles/assessing-cognitive-warfare/.

- 6. Alexandra Souly et al., „Poisoning Attacks on LLMs Require a Near-constant Number of Poison Samples” (Vergiftungsangriffe auf LLMs erfordern eine nahezu konstante Anzahl von Giftproben), arXiv-Vorabdruck arXiv:2510.07192, 8. Oktober 2025, https://arxiv.org/abs/2510.07192.

- 7. Alan Turing Institute, „LLMs May Be More Vulnerable to Data Poisoning than We Thought” (LLMs sind möglicherweise anfälliger für Datenvergiftung als wir dachten), Blog des Alan Turing Institute, 2025, https://www.turing.ac.uk/blog/llms-may-be-more-vulnerable-data-poisoning-we-thought.

- 8. Anthropic, „Small Samples Poison: Backdoor Attacks on LLMs“, Anthropic Research, 2025, https://www.anthropic.com/research/small-samples-poison.

- 9. Lakera AI, „Introduction to Data Poisoning: A 2025 Perspective“, Lakera, 2025, https://www.lakera.ai/blog/training-data-poisoning.

- 10. OWASP GenAI Security Project, „LLM04:2025 Data and Model Poisoning“, OWASP, 2025, https://genai.owasp.org/llmrisk/llm042025-data-and-model-poisoning/.

- 11. Check Point Software, „OWASP Top 10 für LLM-Anwendungen 2025: Daten- und Modellvergiftung“, Check Point, 9. Juni 2025, https://www.checkpoint.com/cyber-hub/what-is-llm-security/data-and-model-poisoning/.

- 12. Daphne Ippolito und Yiming Zhang, „Poisoned Datasets Put AI Models at Risk for Attack“, CyLab, Carnegie Mellon University, 11. Juni 2025, https://www.cylab.cmu.edu/news/2025/06/11-poisoned-datasets-put-ai-models-at-risk-for-attack.html.

- 13. Al Jazeera, „Anthropics vs. das Pentagon: Warum ein KI-Unternehmen gegen die Trump-Regierung vorgeht“, Al Jazeera, 25. Februar 2026, https://www.aljazeera.com/news/2026/2/25/anthropic-vs-the-pentagon-why-ai-firm-is-taking-on-trump-administration.

- 14. Opinio Juris, „Der Konflikt zwischen dem Pentagon und Anthropic über militärische KI-Sicherheitsvorkehrungen“, Opinio Juris, 26. Februar 2026, http://opiniojuris.org/2026/02/26/the-pentagon-anthropic-clash-over-military-ai-guardrails/.

- 15. DefenseScoop, „Die Ära von GenAI.mil ist angebrochen. Die Nutzer reagieren gemischt und haben viele Fragen“, DefenseScoop, 18. Dezember 2025, https://defensescoop.com/2025/12/18/genai-mil-users-have-mixed-reactions-and-many-questions/.

- 16. Center for Strategic and International Studies (CSIS), „Das AI-Problem des Pentagon sind nicht die Algorithmen, sondern die Bewertung“, CSIS, 19. Dezember 2025, https://www.csis.org/analysis/pentagons-ai-problem-isnt-algorithms-its-evaluation.

- 17. Foreign Affairs, „Warum das Militär AI nicht vertrauen kann“, Foreign Affairs, 15. März 2025, https://www.foreignaffairs.com/united-states/why-military-cant-trust-ai.

- 18. Military Intelligence Professional Bulletin, „Narrative Manipulation, Malinfluence Operations, and Cognitive Warfare Through Large Language Model Poisoning with Adversarial Noise“ (Narrative Manipulation, Malinfluence-Operationen und kognitive Kriegsführung durch Vergiftung großer Sprachmodelle mit gegnerischem Rauschen), MIPB, Juli–Dezember 2025, https://mipb.ikn.army.mil/issues/jul-dec-2025/narrative-manipulation-malinfluence-operations-and-cognitive-warfare-through-large-language-model-poisoning-with-adversarial-noise/.

- 19. Polytechnique Insights, „Kognitive Kriegsführung: Was sieben Jahre militärisch-zivile Forschung offenbaren“, Polytechnique Insights, 5. November 2025, https://www.polytechnique-insights.com/en/columns/society/cognitive-warfare-what-seven-years-of-military-civilian-research-reveals/.

- 20. COGINT.org, „Cognitive Intelligence (COGINT)“, abgerufen im Februar 2026, https://www.cogint.org/.

- 21. Dario Amodei, „Machines of Loving Grace“ (Essay), Anthropic, Januar 2026, zitiert in Al Jazeera, „Anthropics vs the Pentagon“.

Bibliografie

Al Jazeera. „Anthropics gegen das Pentagon: Warum ein KI-Unternehmen gegen die Trump-Regierung vorgeht.“ Al Jazeera, 25. Februar 2026. https://www.aljazeera.com/news/2026/2/25/anthropic-vs-the-pentagon-why-ai-firm-is-taking-on-trump-administration.

Amodei, Dario. „Machines of Loving Grace.“ Anthropic, Januar 2026. Zitiert in Al Jazeera, „Anthropics vs. the Pentagon.“

Anthropic. „Small Samples Poison: Backdoor Attacks on LLMs.“ Anthropic Research, 2025. https://www.anthropic.com/research/small-samples-poison.

Center for Strategic and International Studies (CSIS). „The Pentagon’s AI Problem Isn’t Algorithms, It’s Evaluation.” CSIS, 19. Dezember 2025. https://www.csis.org/analysis/pentagons-ai-problem-isnt-algorithms-its-evaluation.

Check Point Software. „OWASP Top 10 für LLM-Anwendungen 2025: Daten- und Modellvergiftung.“ Check Point, 9. Juni 2025. https://www.checkpoint.com/cyber-hub/what-is-llm-security/data-and-model-poisoning/.

COGINT.org. „Kognitive Intelligenz (COGINT).“ Zugriff im Februar 2026. https://www.cogint.org/.

Conde. „The Emergence of Cognitive Intelligence (COGINT) as a New Military Intelligence Collection Discipline.” Journal of Intelligence and Counterintelligence, 2025. https://doi.org/10.1080/08850607.2025.2571497.

DefenseScoop. „Die Ära von GenAI.mil ist angebrochen. Die Nutzer reagieren gemischt und haben viele Fragen.“ DefenseScoop, 18. Dezember 2025. https://defensescoop.com/2025/12/18/genai-mil-users-have-mixed-reactions-and-many-questions/.

Foreign Affairs. „Warum das Militär KI nicht vertrauen kann.“ Foreign Affairs, 15. März 2025. https://www.foreignaffairs.com/united-states/why-military-cant-trust-ai.

Grey Dynamics. „Kriegsführung der fünften Generation: KI im Wahlzyklus.“ Grey Dynamics, 30. November 2025. https://greydynamics.com/fifth-generation-warfare-ai-in-the-election-cycle/.

Grey Dynamics. „Eine Einführung in die Kriegsführung der fünften Generation.“ Grey Dynamics, 30. November 2025. https://greydynamics.com/an-introduction-to-fifth-generation-warfare/.

Hoffman, Frank. „Bewertung der ‚kognitiven Kriegsführung‘.“ Small Wars Journal / Irregular Warfare Initiative, 14. November 2025. https://irregularwarfare.org/articles/assessing-cognitive-warfare/.

Ippolito, Daphne und Yiming Zhang. „Vergiftete Datensätze gefährden KI-Modelle durch Angriffe.“ CyLab, Carnegie Mellon University, 11. Juni 2025. https://www.cylab.cmu.edu/news/2025/06/11-poisoned-datasets-put-ai-models-at-risk-for-attack.html.

Lakera AI. „Einführung in das Thema Datenvergiftung: Eine Perspektive für 2025.“ Lakera, 2025. https://www.lakera.ai/blog/training-data-poisoning.

Lumbaco, Jeremiah „Lumpy“. „Kognitive Kriegsführung zur Dominanz und Neudefinition der Realität des Gegners: Auswirkungen auf die US-Spezialeinheiten.“ SOF Support Foundation, 30. September 2025. https://sofsupport.org/cognitive-warfare-to-dominate-and-redefine-adversary-realities-implications-for-u-s-special-operations-forces/.

Military Intelligence Professional Bulletin. „Narrative Manipulation, Malinfluence Operations, and Cognitive Warfare Through Large Language Model Poisoning with Adversarial Noise.” MIPB, Juli–Dezember 2025. https://mipb.ikn.army.mil/issues/jul-dec-2025/narrative-manipulation-malinfluence-operations-and-cognitive-warfare-through-large-language-model-poisoning-with-adversarial-noise/.

Opinio Juris. „Der Konflikt zwischen Pentagon und Anthropic über militärische KI-Sicherheitsvorkehrungen.“ Opinio Juris, 26. Februar 2026. http://opiniojuris.org/2026/02/26/the-pentagon-anthropic-clash-over-military-ai-guardrails/.

OWASP GenAI Security Project. „LLM04:2025 Daten- und Modellvergiftung.“ OWASP, 2025. https://genai.owasp.org/llmrisk/llm042025-data-and-model-poisoning/.

Polytechnique Insights. „Kognitive Kriegsführung: Was sieben Jahre militärisch-zivile Forschung offenbaren.“ Polytechnique Insights, 5. November 2025. https://www.polytechnique-insights.com/en/columns/society/cognitive-warfare-what-seven-years-of-military-civilian-research-reveals/.

Souly, Alexandra, et al. „Poisoning-Angriffe auf LLMs erfordern eine nahezu konstante Anzahl von Poison-Samples.“ arXiv-Preprint arXiv:2510.07192, 8. Oktober 2025. https://arxiv.org/abs/2510.07192.

The Alan Turing Institute. „LLMs sind möglicherweise anfälliger für Datenvergiftung als wir dachten.“ The Alan Turing Institute Blog, 2025. https://www.turing.ac.uk/blog/llms-may-be-more-vulnerable-data-poisoning-we-thought.

Wikipedia. „Fifth-generation warfare.“ Zuletzt geändert am 10. Oktober 2025. https://en.wikipedia.org/wiki/Fifth-generation_warfare.